Piranka/Getty Images

Cantitatea de date crește mai repede decât capacitatea de stocare. Există soluții?32 min read

Modelul actual de stocare a datelor la discreția utilizatorului presupune construirea în permanență a unor noi centre de date. Asta s-ar putea ciocni în viitorul nu foarte îndepărtat cu țintele de reducere a emisiilor.

La sfârșitul lui 2022, un comunicat publicat de un centru universitar din Marea Britanie, Universitatea Aston, atrăgea atenția asupra unei crize neașteptate: cantitatea de date digitale produsă de omenire se va tripla în următorii doi ani. Cloud-ul nu va putea susține această creștere, în condițiile în care construirea unor centre de date noi se bate cap în cap cu obiectivele climatice asumate de multe state.

E drept, nu era vorba de un studiu care face o analiză serioasă în acest sens, ci de un comunicat care anunța un nou proiect de cercetare susținut de guvernul britanic și la care se pare că va colabora și Universitatea Babeș-Bolyai. Universitatea Aston și-a propus să dezvolte soluții de stocare a datelor mult mai eficiente decât cele din prezent.

Poate că este un mod cam alarmist de a anunța un proiect nou, însă ipoteza este suficient de interesantă pentru o privire mai detaliată. Stocarea aproape perpetuă a informației online este unul din aspectele ce par firești, o parte vitală a internetului. Nici nu avea cum să fie altfel, având în vedere că încă poți vedea comentariile și videourile postate pe YouTube acum 10 ani și Facebook îți reamintește zilnic ce postări stânjenitoare făceai prin 2010.

Mirajul lumii virtuale te face să uiți că întreg internetul este dependent de o infrastructură fizică. Care trebuie întreținută, consumă resurse deloc nesemnificative și, de când a fost pusă pe picioare, trebuie să fie constant îmbunătățită pentru a face față avalanșei de date și utilizatori noi.

Interiorul unui centru de date Amazon Web Services. John Allsaw/Flickr

Ce se întâmplă într-un centru de date?

Centrele de date sunt una din piesele de bază ale acestei infrastructuri. Toată activitatea de pe internet se rezumă la comunicarea între dispozitivul personal și diverse servere, rețele de resurse computaționale și de stocare a datelor pe baza cărora funcționează siteurile, aplicațiile sau orice tip de resursă cloud. Vasta majoritate se află în „What Is a Data Center?”, cisco.com – clădiri construite special pentru a găzdui și a păstra cantități variabile de servere.

În mod tradițional, instituțiile și companiile digitale aveau centre de date găzduite la sediu, unde își mențineau serverele, sau alegeau ca acestea să fie ținute la un provider specializat Însă, mai ales în ultimii 15 ani, giganții tech au construit centre de date masive, în diverse locații, cunoscute de multe ori sub denumirea de centre de date „hyperscale”, suficient de robuste pentru a gestiona aproape orice cantitate de trafic (nu degeaba momentele rare în care pică Facebook sau YouTube sunt breaking news).

Pe de altă parte, companiile de dimensiuni mai reduse s-au reorientat către un model de „co-locație” în care închiriază spațiu pentru a-și instala propriile echipamente într-un centru de date mai mare, unde proprietarul oferă doar lățimea de bandă, energia electrică și alte necesități pentru funcționarea constantă a acestora, iar gestionarea și mentenanța rămân pe seama clientului.

“Cloud”-ul nu e ceva nelimitat. Datele ce trebuie accesate curând sunt stocate tot sub formă de 0 și 1 pe hard diskuri (HDD) sau solid state drives (SSD). E drept, sunt mai performante, longevive și au o capacitate de stocare mai ridicată decât cele disponibile comercial și vin cu diverse forme de back-up. Dar un cloud nu este nelimitat, capacitatea de stocare a acestuia va fi mereu constrânsă de cea a centrelor fizice.

Pentru datele vechi (de obicei între 90 și 120 de zile), care au șanse foarte mici de a fi accesate de utilizatori, în multe centre de date și arhive digitale se folosesc în continuare medii de stocare pe bandă magnetică. Chiar dacă pentru uz comercial sunt o relicvă tehnologică, benzile magnetice sunt un spațiu de stocare mult mai ieftin și mai rezistent decât HDD-urile sau SSD-urile. Pentru că au costuri exponențial mai scăzute de mentenanță, astfel de soluții sunt preferate de multe ori pentru arhivare și backup-uri.

Dezvoltarea tehnologiei pentru acest caz de utilizare a continuat și după ce casetele magnetice au devenit demodate în ochii publicului, așa că s-a ajuns la metode de stocare pe bandă care pot ține și „Mass Data Archiving Acceleration Technology for Magnetic Tape Storage”, fujitsu.com cu potențial de dezvoltare „Hybrid clouds will rely on magnetic tape for decades to come”, ibm.com

Cât de multe date sunt stocate?

Nu toate toate datele create din interacțiuni online sunt stocate în centre de date. De fapt, marea majoritate a acestora nici măcar nu sunt salvate temporar în vreun fel.

Un raport al firmei de cercetare de piață „Data Creation and Replication Will Grow at a Faster Rate Than Installed Storage Capacity, According to the IDC Global DataSphere and StorageSphere Forecasts”, businessire.com estima cantitatea totală de date creată în 2020 la 64,2 Un zettabyte este echivalentul a o mie de exabytes, un milion de petabytes și un miliard de terabytes Însă capacitatea de totală de stocare a datelor la nivel global era semnificativ mai scăzută, estimată la 6,7 ZB. Motivul este că cea mai mare parte a datelor create zilnic sunt temporare, generate strict pentru consumul de moment sau salvate pentru scurt timp înainte de a fi suprascrise de date noi. De altfel, IDC estima că doar 2% din datele noi create în 2020 au rămas stocate în vreun fel și în 2021.

Compania a inclus în studiu și proiecții pentru ritmul în care va crește „datosfera”, cantitatea de date creată anual, dar și capacitatea globală de stocare până în 2025. Prima va ajunge aproximativ 180 ZB peste doi ani, în timp ce cantitatea totală a tuturor modalităților de stocare ar urma să ajungă la aproximativ 16 ZB. IDC a notat faptul că există un ușor decalaj între ritmul de creștere al celor doi indicatori, ceea ce înseamnă că omenirea va putea salva o proporție tot mai mică din datele pe care le creează în următorii ani.

O estimare și mai conservativă a fost prezentată în 2022 de o altă firmă de analiză, „Zettabyte era brings archiving front and center”, blocksandfiles.com care proiecta o creștere la „doar” 11,7 ZB a datelor care vor fi stocate în 2025. 80% din acestea ar urma să fie reprezentată de informație arhivată – acele date mai vechi de 90-120 de zile care au o probabilitate de accesare redusă, și sunt trecute din arhivele active tip cloud în cele pe bază de bandă magnetică – în creștere de la o proporție de aproximativ 60% în 2020.

Centru de date hyperscale deținut de Google în Council Bluffs, Iowa, SUA. Chad Davis/Flickr

Datosfera dă pe-afară?

Nu este prima dată când industria tech este pusă în fața unei creșteri exponențiale a cantității de informație digitală creată de oameni. În fapt, aceasta a crescut între 2010 și 2020 de 32 de ori, pornind de la o cantitate totală de doar „Total data volume worldwide 2010-2020”, statista.com

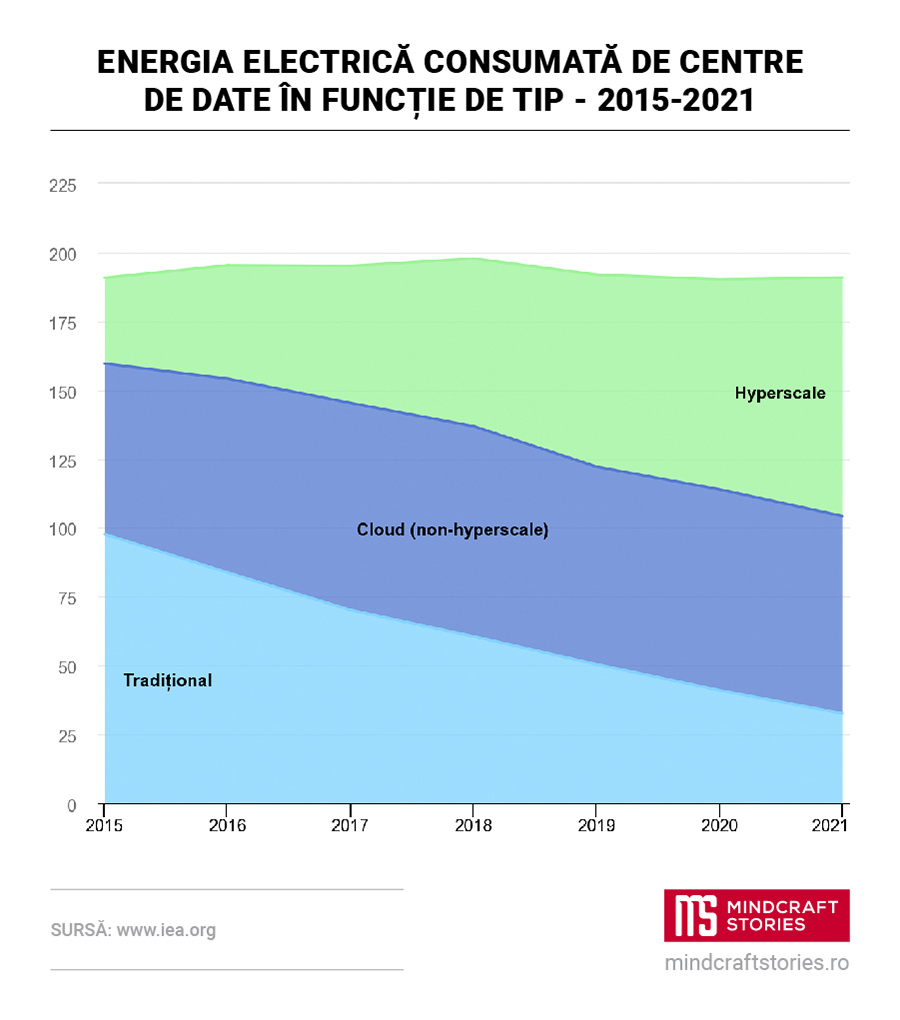

În aceeași perioadă, impactul global al energiei necesare pentru funcționarea centrelor de date nu a crescut prea mult. „Data Centres and Data Transmission Networks”, iea.org arată că procentajul de energie electrică necesitat de centrele de date la nivel global a rămas în ultimul deceniu în jurul a 1% din cerințele de electricitate ale întregului mapamond. În termeni de consum real, acesta a crescut de la 200 terawatt-oră (TWh) în 2015 la între 220 și 320 TWh în 2021 – o creștere cu între 10 și 60%, foarte mică în condițiile în care traficul pe internet a crescut cu 440% și volumul de muncă al centrelor de date cu 260% în aceeași perioadă.

De ce se tem, atunci, cercetătorii de o posibilă criză a stocării informației?

„Energy-efficient Cloud Computing Technologies and Policies for an Eco-friendly Cloud Market”, europa.eu arată faptul că impactul centrelor de date este mult mai disproporționat la nivel regional. Conform acestuia, centrele de date din statele UE reprezentau 2,7% din totalul cerințelor de energie electrică ale blocului comunitar, proporție așteptată să crească la 3,2% în 2030. „Data Centres Metered Electricity Consumption 2021”, cso.ie de exemplu, consumul de electricitate al centrelor de date s-a triplat între 2015 și 2021, ajungând de la 5% la 14% din consumul total al țării, cu o evoluție similară prognozată și pentru Danemarca până în 2025.

Și mai important, însă, este faptul că raportul ridică temeri privind creșterea cererii pentru capacități de stocare, notând că inovațiile tehnologice și eficientizarea metodelor de stocare ar putea să nu mai țină în frâu o eventuală creștere masivă a cerințelor de electricitate în centre de date, precum s-a întâmplat în trecut. Ceea ce se bate cap în cap cu eforturile majore care vor fi necesare în multe state pentru a atinge țintele de eficiență energetică și net zero din următoarele decenii.

Salvăm planeta sau datele?

Impactul climatic exact pe care îl au centrele de date a rămas un subiect mai de nișă, în contextul în care regulatorii au fost ocupați cu alte domenii care produc semnificativ mai multe emisii, iar serviciul este unul vital pentru lumea digitală modernă – fără de care nu ar putea funcționa, de exemplu, munca de la distanță, o activitate cu potențial ridicat de a avea un impact climatic pozitiv. Însă contează și faptul că majoritatea atenției se concentrează pe centrele de date hyperscale construite în ultimul deceniu de companiile Big Tech, care au avut grijă de la bun început să treacă discuția despre centrele de date în sfera responsabilității pentru mediu.

De exemplu, conform raportului IEA, Apple, Google sau Meta declară că centrele proprii de date, și în fapt toată electricitate pe care o consumă este „echivalată 100% din surse regenerabile”. Amazon, al cărui AWS este cel mai mare provider de servicii cloud din lume, a declarat această valoare la 85%, cu o țintă de a atinge 100% pentru 2025.

Asta nu înseamnă neapărat că centrele lor de date și funcționează doar pe baza surselor regenerabile, ci doar că aceste companii cumpără energie verde de la producători echivalentă cu valoarea consumului lor anual de electricitate. În practică, cel puțin o parte dintre centrele lor ar putea să funcționeze în continuare pe energie convențională. Chiar și multe dintre cele care funcționează pe energie verde au în continuare generatoare de rezervă pe bază de combustibili fosili, „Addressing the carbon footprint of data centre backup power ”, digitalinfranetwork.com

În orice caz, acest aspect este neclar, pentru că giganții tech nu publică statistici în detaliu despre consumul și sursa fiecărui centru în parte. Google și Microsoft sunt singurele care au recunoscut această problemă, punându-și ținta de a atinge 100% energie regenerabilă în toate centrele lor de date până în 2030.

Cel puțin ritmul de creștere al unor astfel de centre este constant: în prezent se află în construcție sute de centre de date noi de tip hyperscale, numărul acestora urmând să crească de la aproximativ 800 până la în jur de 1.200 în 2026. Cel mai mare ritm de construcție îl au marile corporații tech din China, precum ByteDance, Alibaba sau Tencent, pentru care există mai puține date și „China’s data center emissions set to double, says Greenpeace”, datacenterdynamics.com

Pe lângă emisii, centrele de date mai aduc câteva aspecte îngrijorătoare pe partea de mediu. În primul rând, multe dintre ele folosesc sisteme de răcire pe bază de apă pentru a păstra temperaturi adecvate funcționării serverelor în incinte. Și, în ciuda faptului că este o resursă regenerabilă, pot exista probleme în funcție de zona și infrastructura la care acestea sunt conectate – precum centrele de date din California, care „West megadrought intersects with data center water use”, protocol.com/

În fapt, o cincime din centrele de date din Statele Unite folosesc ca sursă de apă bazine aflate sub stres ridicat sau moderat, conform „The environmental footprint of data centers in the United States”, lib.vt.edu

Există, desigur, și problema deșeurilor electronice, în condițiile în care atât HDD-urile, cât și SSD-urile cedează la un moment dat, iar la nivel global „E-waste: Five billion phones to be thrown away in 2022”, bbc.com

Este o altă zonă care nu este acoperită în rapoartele care vor să arate cât de conștiente sunt companiile Big Tech de impactul lor climatic. Înlocuirea drive-urilor stricate, precum și dotarea centrelor de date noi, provoacă o creștere continuă a unei industrii care are nevoie de resurse rare, precum cobalt, paladiu, platină sau neodim, minate în multe cazuri „Precious Metal In Computer Components”, conceptmanagement.co.uk

Într-un fel, problema nu este că n-ar putea fi construite destule centre de date noi pentru a satisface o lume tot mai digitalizată – avertismentul cercetătorilor de la Aston că o penurie de stocare ar urma să aibă loc în trei ani pare mai degrabă o tactică de a atrage atenția asupra unei probleme mult mai complexe de atât –, ci faptul că întrebarea mai pertinentă este cât de oportună ar fi construirea lor, în condițiile în care țintele de neutralitate climatică sunt oricum dificil de atins.

Iar dacă răspunsul este nu, există alternative la a te baza în continuare pe o rată de creștere a eficienței tehnologiei care să țină în frâu consumul de energie al centrelor de date, sau la a spera la noi algoritmi revoluționari de comprimare a datelor?

Jasmin Merdan/Getty Images

Stocăm arhivele în ADN, 5D sau atomi?

Soluțiile există, dar ele sunt deocamdată la nivelul de propuneri sau proiecte de cercetare care nu se află prea aproape de o fază de testare industrială.

De exemplu, „Too much information – Aston University researchers to tackle global data storage crisis”, aston.co.uk ar urma să experimenteze chimic cu polimeri cu scopul de a crea suprafețe cu o lățime a canalelor de doar 5 nanometri – de 10.000 ori mai mici decât un fir de păr – care să poată stoca cumva informația, cu eficiență mult mai ridicate de capacitate per spațiu decât soluțiile actuale de stocare.

Însă nu au fost oferite detalii mai specifice despre cum ar putea funcționa un astfel de dispozitiv, semnalând că este vorba de o fază pur experimentală. Oarecum surprinzător, printre partenerii proiectului este trecută și Universitatea Babeș-Bolyai din Cluj, deși partea română nu a comunicat nimic pe această temă până în prezent.

Nu este prima dată când cercetătorii britanici încearcă să găsească metode inovatoare de stocare a datelor. „Eternal 5D data storage could record the history of humankind”, southampton.ac.uk Centrul de Cercetare în Optoelectronică a Universității din Southampton a dezvoltat o metodă prin care o bucată de sticlă de dimensiunea unei monede poate găzdui până la 370 TB, pe o perioadă de miliarde de ani, la temperatura camerei.

Autorii au numit metoda „5D”, de la o combinație a celor trei dimensiuni fizice cu două dimensiuni optice. Într-o explicație simplistă, metoda este similară cu procesul de inscripționare al unui CD, cu diferența că procesul nu are loc la suprafață, ci în interiorul sticlei. Dezvoltarea metodei continuă, iar cercetătorii au reușit în 2021 să creeze o variantă cu 500 de terabytes, „High-Speed Laser Writing Method Could Pack 500 Terabytes of Data into CD-Sized Glass Disc”, optica.co.uk

O propunere care pare și mai futuristă „Could all your digital photos be stored as DNA?”, mit.edu Conceptul este simplu de înțeles: la fel cum absolut toate datele transmise digital, de la mesaje la clipuri video 8k, sunt codate în șiruri de 0 și 1, aceeași informație ar putea fi transpusă în sistemul de secvențe folosit de cele patru nucleotide, A, T, G și C. Până la urmă, ADN-ul, sistemul de stocare al informației din corpul uman, este de mii de ori mai dens decât orice tip de memorie flash, nu consumă energie și poate rezista semnificativ mai mult și decât benzile magnetice.

ADN-ul are avantajul că este o tehnologie dovedită: în 2012, cercetători de la Harvard au reușit să codeze în nucleotide o carte cu 52.000 de cuvinte. Iar nouă ani mai târziu, o echipă de la MIT a creat o metodă de a extrage cu precizie datele dorite din numărul foarte mare de secvențe ale unei molecule de ADN.

Problema în acest caz este costul extrem de mare de sintetizare și secvențiere a moleculei, estimat la un trilion de dolari pentru fiecare petabyte. În plus, metoda „DNA could store all of the world’s data in one room”, science.org

O soluție mai pretabilă pentru cloud ar putea fi dispozitivele cuantice. O bază pentru o viitoare memorie cuantică „Quantum Memory Storage is More Efficient and Secure Than Ever”, futurism.com care au reușit să stocheze și să recupereze date în formă cuantică din nucleul unui atom. Unitatea de bază a informației cuantice, qubitul, poate avea un număr infinit de stări, nu doar 0 și 1, ceea ce în termeni de stocare a datelor ar putea reprezenta o eficiență exponențial mai ridicată decât oricare din metodele actuale. În acest caz, obstacolul este că tehnologia încă nu poate fi folosită în mod eficient pentru costurile implicate în afara laboratoarelor de cercetare (și în multe cazuri nici în interiorul acestora).

Doar că, până când vreuna din aceste propuneri va ajunge suficient de matură pentru a salva din spațiul și resursele necesare centrelor de date, s-ar putea ca în viitorul deloc îndepărtat să apară o dilemă mult mai rudimentară: rămân providerii de cloud și operatorii de rețele sociale la modelul în care oricine poate stoca date nelimitat, sau vor ajunge aceștia, sub presiunea unei cantități imense de date și a obligațiilor de net zero pentru centre, să devină mai selective cu ce rămâne online constant?