Matt Jeacock/Getty Images

Un start-up românesc folosește fizica socială pentru a construi algoritmi etici60 min read

Paradigm, un proiect dezvoltat de fizicieni români, propune un algoritm care folosește fizica socială pentru background check-uri complexe și studierea comunităților

Sunt puține tehnologii a căror imagine a avut mai mult de suferit recent decât algoritmii. De la scandaluri despre cum asistă dezinformarea și controversele pe rețelele sociale la cele legate de încălcarea dreptului la intimitate și profilare socială, prea multe dintre controversele majore din zona tech din ultimii ani au avut legătură cu algoritmii, iar unele dintre ele au avut „AI: Decoded: A Dutch algorithm scandal serves a warning to Europe — The AI Act won’t save us”, politico.eu

Mai multe detalii pe linkedin.com un start-up creat de fizicieni români care vrea să se extindă și pe piața din Germania, vede însă o oportunitate pentru aplicații mult mai utile și etice ale tehnologiei algoritmilor. La cea mai recentă ediție a hackatonului Mai multe detalii pe innovationlabs.ro fondatorii start-up-ului au prezentat Paradigm, o soluție bazată pe algoritmi și inteligență artificială pe care vor să o propună inițial în zona de business, pentru ca pe termen lung să poată fi folosită chiar și în politici publice.

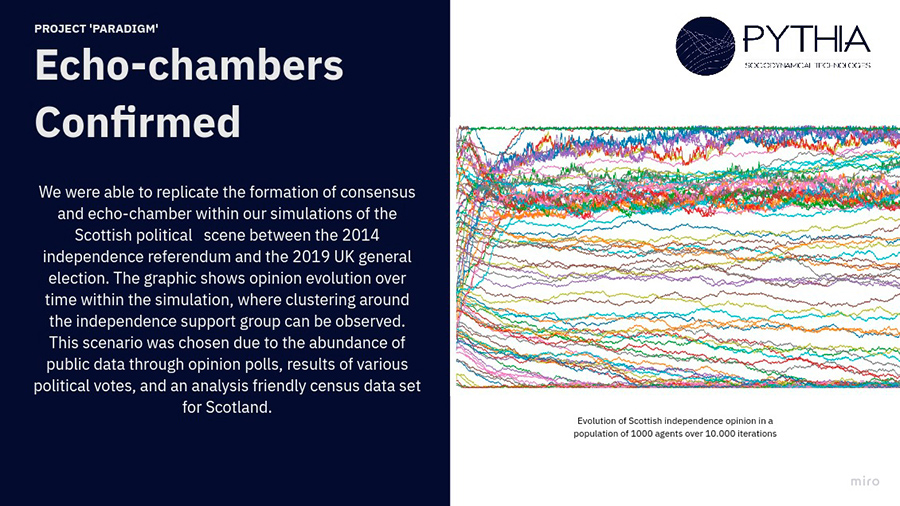

Cea mai fascinantă parte din Paradigm este premisa din spatele proiectului: el se bazează pe fizica socială, un domeniu care preia teorii din fizica clasică și le aplică în sociologie pentru a crea modele complexe ale dinamicilor comunităților umane. Domeniul nu e neapărat departe de modul în care statistica matematică era folosită în psihoistoria lui Asimov.

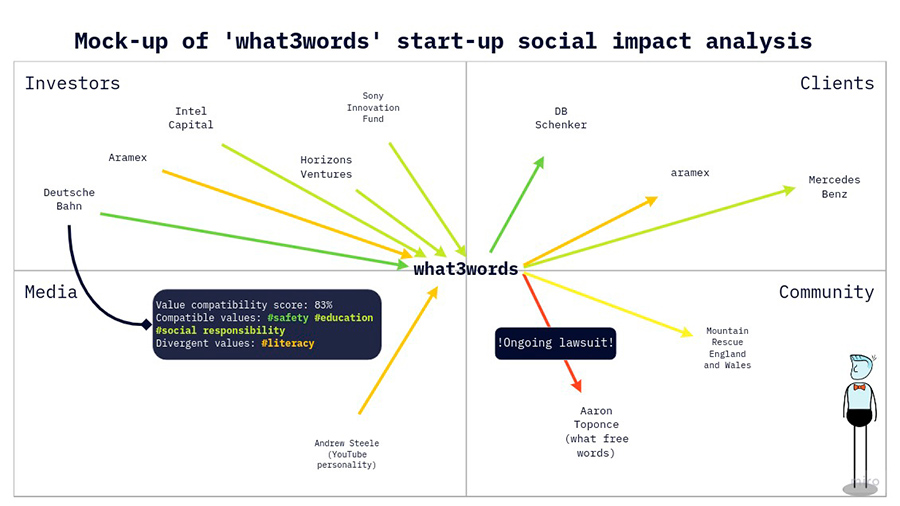

În practică, Paradigm este dezvoltat ca soluție pentru companiile și investitorii care vor un instrument prin care să facă background check-uri mai complexe, unde ar pot vedea dacă un potențial partener a avut în trecut interacțiuni sau declarații contrare valorilor pe care și le asumă. Un AI care judecă indivizi sau companii pe baza valorilor afișate public sună distopic, însă este vorba mai mult de o soluție auxiliară, menită să asiste analișții companiilor în a evita scandalurile de imagine.

Fondatorii Pythia își propun însă, pe termen lung, să creeze un instrument care ar putea ajuta ONG-urile și societatea civilă să descopere conflicte de interese ale politicienilor, să facă modele de comunicare publică mai eficiente în a combate dezinformarea sau chiar să ajute decidenții să observe impactul ascuns al măsurilor pe care aceștia le iau. Totul, în timp ce respectă privacy-ul persoanelor și entităților care nu sunt publice, dar și un cod etic care ar împiedica, pe cât posibil, folosirea Paradigm în scopuri imorale.

Am vorbit cu unul dintre co-fondatorii Pythia, Luca Mihăilescu, despre cum se îmbină fizica, sociologia și machine learning-ul în Paradigm, despre cum algoritmii pot fi folosiți (și) în moduri etice și cum pot ajuta modele făcute pentru aliaje și magneți la o înțelegere mai bună a modului în care funcționează comunitățile umane.

CITEȘTE ȘI: Fundația și psihoistoria. Poate fi prezisă istoria în realitate?

Mindcraft Stories: Cum a început proiectul Pythia și de unde a apărut ideea pentru Paradigm?

Luca Mihăilescu: Eu studiez fizica, m-am specializat mai mult pe fizica teoretică și computațională.

Paradigm a început de la lucrarea mea de licență, când am început să mă concentrez pe domeniul ăsta al studiului fizic al fenomenelor sociale. Se numește fizică socială, sună puțin ciudat, dar este un câmp nou, între fizica computațională și sociologie, unde eu am văzut foarte mult potențial.

Plecând de la lucrarea mea de licență, unde am dezvoltat propriul meu model de diseminare a opiniilor într-o rețea socială – deci practic cum evoluează opinia oamenilor într-o comunitate –, am vrut să continui să dezvolt proiectul ăsta. Am vrut să merg puțin mai departe și, împreună cu un coleg de la facultate, Radu Tîrca, am început compania asta și ne-am propus să dezvoltăm un algoritm puternic și fiabil pentru piață.

Vrem să cercetăm în continuare un domeniu care este în plină dezvoltare și care este foarte promițător, mai ales pentru următorii zece ani. Paradigm este o investiție pe termen lung, dar care își propune să aducă câteva produse care să fie viabile pe piață în momentul ăsta. Este un produs, practic, de analiză a responsabilității sociale a posibililor parteneri corporate pe care îi are o companie.

Luca Mihailescu, arhiva personală

M.S: Cum i-ai explica Paradigm unei persoane care aude pentru prima dată despre acest proiect?

L.M: Imaginează-ți că ești o companie sau un grup de investiții care vrea să verifice dacă unul dintre potențialii parteneri are valori care se potrivesc cu ale lor. În zilele noastre, companiile sunt trase la răspundere pentru ce valori susțin, pe de-o parte. Pe de altă parte, valorile pe care o companie susține că le are nu sunt neapărat valorile pe care le are.

Și atunci, când lumea se uită la tine, o să se uite și la valorile partenerilor. Din acest motiv, ele trebuie să fie corelate, pentru că vrei să eviți un scandal în presă. Mai ales dacă ești investitor sau dacă ești o companie de PR, ar fi dezastruos dacă unul dintre influencerii pe care i-ai plătit, să zicem, intră într un scandal mediatic, ceea ce te va influența direct pe tine.

Soluția în momentul actual este următoarea: toate companiile cărora le pasă de imaginea lor fac verificări asupra posibililor parteneri, asupra parteneriatelor cu influență și așa mai departe. Problema este că verificările acestea durează foarte mult și, dacă vrei să le faci serios, pot dura până la câteva luni în cazuri unor posibile investiții. În momentul ăsta, ele se fac de mână. Trebuie să faci scraping, să te uiți pe social media, să vezi care au fost interacțiunile lor, ce tweeturi au postat acum doi ani, trei ani. Iei toate informațiile astea, le sortezi, apoi selectezi din ele, pentru niște analiști care să ducă mai departe verificarea și să vadă exact care sunt valorile pe care le susține compania sau persoana vizată.

Asta se poate automatiza, ceea ce se face deja într-o oarecare măsură prin automatizarea părții de culegere a informațiilor de pe internet, de pe social media, din articole și așa mai departe. Se numește scraping sau opinion mining – îți sortează într-un fel informațiile, dar tot rămâne o muncă foarte mare de a înțelege exact ce se întâmplă acolo. Pe aceasta trebuie să o facă un om.

Prin Paradigm, noi venim cu un strat în plus. Produsul nostru ia informațiile de pe internet, le strânge automat și apoi poate să analizeze exact care este harta de interacțiuni între partenerii diferitelor companii, ca să-ți dai unde seama unde sunt punctele în care trebuie să te uiți mai cu atenție pentru a vedea care sunt valorile lor. Și atunci se elimină încă un pas de analiză, în sensul în care noi oferim deja harta asta a interacțiunilor, a afirmațiilor, a valorilor sociale, astfel încât clientul nostru să poată să investească resursele pentru a face analiza fix acolo unde contează, pentru că algoritmul îi va spune unde trebuie să se uite.

Să luăm exemplul unui investitor. Dacă vrea să verifice o companie în care intenționează să investească, poate să folosească un algoritm de tip Un termen care descrie toate tipurile de AI cu sistem închis, ale cărui operațiuni interne nu sunt vizibile de către o parte terță. Pus mai simplu, este vorba de AI-urile care îți oferă un răspuns la o problemă, dar nu și o argumentație pentru modul în care au ajuns la acel răspuns care îi va face un scor sustenabilitate socială automatizat, și pe baza lui investitorul ar trebui să zică da sau nu. Acum, dacă scorul ăsta este prea mic și investitorul zice nu, pe ce bază refuză? Pentru că nu știe exact pe ce se bazează un algoritm obscur.

În schimb, cu algoritmul nostru ar avea la dispoziție scorul, dar ar ști exact și de unde vine contribuția negativă la el; ar ști să se uite și să justifice în fața posibilului partener: uite aici avem noi probleme cu interacțiunea pe care ai avut-o acum doi ani cu această companie, care din punctul nostru de vedere nu se aliniază cu valorile noastre, poate ne explici mai departe.

Deci este un algoritm care automatizează exact părțile esențiale, ca să permită analiștilor să se concentreze pe ce e important în procesul de rating și în același timp este un algoritm transparent, în care tu știi exact care sunt influențele asupra scorului.

M.S: Paradigm analizează și conținutul interacțiunii în sine sau doar oferă informația că a avut loc o interacțiune problematică? Dacă da, contribuie și conținutul la scor?

L.M: Da, scorul se bazează pe conținutul analizat. Însă nu îl oferim ca data dump, ca o bază masivă de date în care zicem „uite, aici sunt toate comentariile, nu mai stai tu pe Facebook să le analizezi, le ai în acest document text”. Noi mergem un pas mai departe și analizăm prin algoritmul nostru toate aceste interacțiuni pentru a oferi un scor, dar prezentăm și posibilitatea de a vedea pe ce se bazează scorul, de exemplu care este interacțiunea care îl scade sau aduce mult în sus. Și să vezi după unde exact a fost interacțiunea respectivă și s-o analizezi mai în detaliu.

M.S: Ce factori sunt luați în considerare atunci când vine vorba de stabilirea unui scor pentru interacțiuni?

L.M: Noi luăm în considerare valorile care sunt date de clienți. Adică ei stabilesc o serie de valori pe care îi interesează – cum ar fi sustenabilitatea, poziția față de educație sau față de diferite probleme sociale –, iar noi putem să programăm în algoritmul nostru exact analiza pe baza acestor valori și să vedem cum se raportează companiile sau persoanele vizate la ele.

Asta este o problemă de AI și de analiză a textului, ceva noi putem face. Este foarte mult machine learning, mai ales la partea de selecție și de analiză a textului, peste care vine algoritmul, care stabilește relațiile și le face cumva transparente pentru analist.

M.S: Întorcându-ne puțin la partea de fizică socială, cum aplică acest domeniu concepte din fizica clasică, de exemplu, în studiul opiniei publice?

L.M: Aici sunt niște lucruri interesante despre cum a apărut și cum s-a solidificat domeniul.

Acum patruzeci de ani, începeau deja să apară modele de simulare socială făcute de sociologi, care simulau cum se influențează oamenii între ei sau cum se răspândesc opiniile într-o societate. Modelele astea sunt greu de făcut, deoarece trebuie de fiecare dată să simplifici cât mai mult problema abordată în așa fel încât să poată fi procesată de un computer, dar în același timp nu într-un mod care să elimine din comportamentele semnificative. Adică să nu aduci modelul la un nivel atât de simplu încât să nu să nu mai aibă nimic de-a face cu o societate reală.

La un moment dat, prin anii ’90, au fost fizicieni care au descoperit aceste modele și și-au dat seama că sunt foarte similare cu cele din activitatea lor, doar că ei le aveau deja în formele cele mai ușor de folosit. Modelul de bază de la care pleacă cele mai multe modele de interacțiune socială este „Ising Model”, stanford.edu care este practic un model al comportamentului metalelor, despre cum se formează magneții.

Este ceva foarte simplu: să zicem că ai niște atomi, fiecare cu un spin și polarizare proprie. Fiecare particulă din atom este influențată în așa fel încât să aibă o polarizare similară cu cea a vecinilor lor.

Dacă te gândești, asta este similar cu ce se întâmplă în societate. Tu ai oameni cu care interacționezi și se exercită o presiune socială asupra ta ca să-ți aliniezi opiniile cu cei din jurul tău. Aici vine partea de simulare socială: ce se întâmplă când în jurul tău sunt opinii diferite și cum se va face polarizarea asta?

Există o corelație foarte puternică aici, pentru că în anii ’90 s-a descoperit că se suprapun aceste modele, de exemplu cu modelul aliajelor. Este un model teoretic din termodinamică care spune practic cum se vor mixa aliaje în funcție de anumiți factori. S-a determinat că dacă se iau anumiți parametri de entalpie, de temperatură și de energie din aceste sisteme, se pot modela fenomene sociale în mod similar, practic se potrivesc modelele.

Asta nu spune ceva intrinsec, cum ar fi că oamenii sunt aliaje, bineînțeles, dar spune ceva foarte interesant despre cum se suprapun parametrii aceștia din termodinamică, care în mare parte sunt parametri statistici, cu dinamicile sociale și ce pot spune despre ele.

O altă descoperire foarte interesantă a fost temperatura – un parametru statistic în modelele pe care le dezvoltau fizicienii preluat în cele ale sociologilor. Temperatura este asociată de fapt cu toleranța într-o societate și deschiderea față de idei noi – cât de dispus ești să te asociezi cu oameni cu opinii diferite față de tine. Este extraordinar de interesantă pentru că, dacă-ți imaginezi, într-un metal cu o temperatură foarte mare, acele polarizări între particule nu se vor mai realiza, va exista zgomotul termic, o agitație termică.

La fel este și într-o societate, dacă temperatura crește, deci dacă toleranța crește, va exista această agitație termică, o tendință de a fi deschis la idei, de a schimba opinia mai ușor și de a nu te polariza și închide într-un singur cluster de opinii, de a nu intra într-un eco-chamber din care nu mai poți să ieși.

Toate aceste suprapuneri foarte interesante între modelele fizico-statistice dezvoltate până acum și modelele sociale duc la nevoia de a cerceta în continuare corelația între anumite anumite modele pe care le avem deja și cum se aplică ele în societate, pentru că multe dintre ele spun lucruri foarte interesante.

Cu astfel de modele ale fizicii statistice, se pot face modele sociale mult mai complexe și care prezic mult mai bine fenomenele sociale decât se făceau acum 40 de ani. Mergem într-o direcție foarte interesantă, în care suntem științific aproape de a înțelege mai bine cum se formează polarizarea într-o societate și cum poate fi ea evitată. Cum poți, de exemplu să crești flow-ul de informație în așa fel încât lumea să fie informată într-un mod egal și echitabil și să nu se mai formeze eco-chambere.

Și aici este marea oportunitate pe care o vedem noi pe termen lung. Faptul că în acest domeniu poți să înțelegi societatea la un nivel în care îți permite să faci un engineering al politicilor sociale, al strategiilor de informare astfel încât să ajungă la cât mai mulți oameni. Ceea ce în momentul ăsta asta nu se întâmplă; dacă avem informări publice, ele ajung la o categorie foarte restrânsă de oameni, însă o mare parte a populației, acea minoritate tăcută, își va lua informațiile din altă parte, și așa se răspândește fake news-ul.

De ce să nu încercăm să creăm strategii de informare mai bune care să ajute lumea să aibă informațiile astea? Putem să înțelegem modul în care să realizăm asta, încetul cu încetul, cu fizica socială.

M.S: Poți să-mi dai un exemplu despre cum sunt folosite conceptele de fizică socială în Paradigm?

L.M: În algoritm modelăm agenți, care pot fi atât persoane publice din social media cât și entități de business. Le modelăm ca pe niște particule, dar care nu se află într-un spațiu fizic, ci într-un spațiu al valorilor. Noi luăm valorile care ne interesează și încercăm să vedem cum se poziționează. De exemplu – fac o generalizare foarte mare acum – cât la sută ești progresist, cât la sută ești pro-biciclete, cât la sută ești pro-sancțiuni economice împotriva Rusiei. Apoipoziționăm agenții în acest spațiu.

Pe baza scraping-ului, se poate vedea cum se conectează agenții între ei, și poți determina niște ecuații fizice, despre energia și temperatura care descriu relațiile între acești agenți. Această energie nu este altceva decât o unitate pentru cât de compatibilă sau incompatibilă este o relație între agenți, și va deveni până la urmă, după aplicarea unor funcții, scorul nostru de sustenabilitate socială, determinat în funcție de valorile companiei cu care lucrăm.

Noi punem agenții într-un astfel de model în care determină măsuri fizice, precum energia relațiilor dintre ei agenți sau temperatura întregului sistem. Bineînțeles, n-o să le prezentăm clienților ca temperatură sau energie, ci ca scor de sustenabilitate socială, ca scorul general de toleranță al ecosistemului companiei și așa mai departe.

Dar, la bază, ele sunt niște unități de măsură statistice care se aplică atât în fizică, cât și în domeniul social. Noi le aplicăm pentru prima dată într-un domeniu de business, astfel încât să obținem informații utile din conceptul abstract al temperaturii unui ecosistem. Nu este vorba de temperatură pentru majoritatea lumii, ci este vorba despre cât de tolerant este ecosistemul în care se află partenerul tău. Pentru că vrei să afli asta, vrei să afli cât de susceptibil este de exemplu la a face bule de informații sau la a nu ieși din zona lui de interes.

Exemplu al unei analize business făcute prin Paradigm. Pythia

M.S: De unde se face acest opinion mining? Doar din rețele sociale sau și din presă sau alte comunicări publice?

L.M: Noi vrem să facem aici niște boți de opinion mining pe trei piloni de informație: social media, presă (și aici trebuie să luăm presa relevantă pentru domeniul respectiv) și, în cele din urmă, rapoarte ale ONG-urilor.

Sunt trei aplicații de opinion mining care trebuie dezvoltate diferit pentru fiecare dintre ele. Pentru că presa e diferită de social media, iar rapoartele ONG-urilor sunt diferite la rândul lor, sunt limbaje diferite și trebuie să antrenăm AI-ul pentru fiecare dintre ele.

Dar ele nu sunt atât de diferite încât să fie necesară o complet altă tehnologie. Aceeași tehnologie pe care noi vrem să o aplicăm mai întâi pe social media o vom aplica apoi pe presă și, în cele din urmă, pe rapoartele ONG-urilor.

M.S: Cum plănuiți să luați în calcul problemele deja clasice ale mediului online, de exemplu postări șterse sau modificate pe social media, articole tendențioase sau clickbait-uri din presă?

L.M: În primul rând, când iei în considerare articole din presă trebuie să iei în considerare acel compas politic, orientarea politică a publicației. Și să judeci de la început faptul că acea publicație are un bias într-o anumită direcție, ca apoi ajustezi informațiile obținute în funcție de asta. Numai că asta este o muncă care trebuie făcută o singură dată, când selectezi publicațiile de presă în care vrei să faci scraping, și care se aplică ulterior de fiecare dată.

La nivelul social media, este într-adevăr o provocare și niciodată nu vei putea să reușești să salvezi absolut toate informațiile. Dar există arhive care cuprind mare parte din ele și atunci putem încerca să recuperăm majoritatea lucrurilor care contează în social media. Bineînțeles, nu vei putea niciodată să ai o imagine 100% completă asupra a tot ce s a întâmplat, a tuturor dintre acțiunilor pe care le au avut toți prietenii tăi vreodată. Asta este imposibil, dar ca eficiență, un algoritm o poate face mult mai bine decât o poate face un om.

M.S: Cum o să abordați problemele de înțelegere a limbajului de către AI? De exemplu, riscul ca algoritmul să facă niște judecăți false asupra valorilor dintr-o înțelegere eronată a nuanțelor limbajului uman.

L.M: Asta este mai mult o problemă de statistică. Eficiența algoritmilor de acest fel merge undeva de la 60%, care e slăbuț, până pe la 90%, care este ceva absolut extraordinar. Noi trebuie să alegem setul de date astfel încât să antrenăm cât mai bine algoritmul nostru să înțeleagă exact aceste nuanțe. Însă asta este ceva ce se îmbunătățește și. cu timpul; dacă pleci de la o acuratețe de 70% să zicem, o s-o îmbunătățești pe măsură ce faci mai multe simulări și strângi mai multe date.

Acum, când ai o acuratețe de 70% trebuie să-ți asumi că nu vei avea înțelegerea completă si perfectă a fiecărui comentariu. Dar tocmai de asta este bine că algoritmul nostru este unul transparent, în care, când ți se dă un scor negativ, zice exact de unde vine și care au fost elementele care au contribuit la acest scor, astfel încât elementul uman să poată decidă singur dacă au fost făcute analizele corect sau dacă există anumite probleme. Și dacă da, cât de mari sunt problemele astea.

Din punctul ăsta de vedere, acesta este un mod foarte onest de a face un algoritm. Este un algoritm transparent în care clientul poate să vadă foarte bine de unde vin elementele care au dus la decizia X și care sunt dinamicile care guvernează analiza noastră. O rețea gigantică foarte bine antrenată de tip black box ți-ar fi dat aceleași informații finale și aceleași scoruri, dar nu ai altă opțiune decât să ai încredere în ce spune acel algoritm. Și nu vrei asta, nu vrei să-ți zică un algoritm „Uite, așa este, crede-mă!” Pentru că, dacă nu-l crezi înseamnă că ai plătit algoritmul degeaba, iar dacă ai încredere în el trebuie pur și simplu să mergi pe încredere până când întâlnești destule eșecuri și destule greșeli gigantice ale algoritmului ca să-ți dai seama că de fapt era prost.

În cazul algoritmului nostru este mai simplu, poți să vezi dacă este prost sau nu. Noi zicem că este unul bun și prin asta vrem să convingem, prin faptul că tu poți să vezi de unde vin deciziile și poți să vezi exact unde este corect și unde greșește. Este un tool de asistență mai mult decât de verdict, nu intenționează să scoată factorul uman decizional final, ci doar să automatizeze partea asta gigantică, care până acum nu putea fi automatizată, de înțelegere a ecosistemului în care se află posibilul tău partener.

M.S: Cum ia în calcul algoritmul situațiile în care un agent își schimbă în timp opinia și își modifică modul în care se raportează la anumite valori și anumite subiecte?

L.M: Da, și ăsta este un factor luat în considerare. Când faci o simulare de genul ăsta există un factor de decay să zicem al opiniilor vechi, pe măsură ce apar unele noi. Ce s-a întâmplat în trecut va avea o greutate, însă dezvoltăm metodele care să ne permită să vedem cum oamenii își schimbă opinia, pentru că despre asta este algoritmul nostru, despre cum oamenii și comunitățile își schimbă opiniile, nu judecă ca și cum ar fi monoliți în timp, care își păstrează aceleași opinii și aceleași poziții tot timpul. Noi luăm în considerare faptul că opiniile se schimbă și asta este, de fapt, ce studiem. Poate te uiți în trecut și zici că au existat probleme – asta îți va arăta produsul. În schimb, nu înseamnă că opiniile nu se schimbă. Și va arăta că s-au schimbat.

M.S: Aveți în plan să oferiți acest instrument și societății civile, de exemplu ONG-uri care vor să facă verificări de integritate sau ale unor eventuale conflicte de interese?

L.M: Exact acesta este scopul nostru. În momentul în care algoritmul va fi la un nivel de dezvoltare suficient, vrem să ne orientăm spre zona de societate civilă. Pentru ei ar fi adevăratul ajutor al acestui algoritm. Ideea este că necesitățile lor sunt mult mai mari și mai complexe, iar mizele sunt mult mai mari, pentru că sunt lucruri care pot afecta întreaga societate. E o responsabilitate mult mai mare pe care trebuie să ne-o asumăm și în condițiile acestea trebuie să venim cu un algoritm care să fie mai bine testat. La asta vrem să ajungem.

Deocamdată ne orientăm pe partea de business, dar targetul nostru final este să începem să colaborăm cu societatea civilă și cu cei care crează politicile publice. Începem deja să avem contacte astfel încât să putem crea un produs care să fie chiar util, de exemplu pentru a identifica comunitățile care sunt dezavantajate. Sau care sunt minoritățile tăcute cu adevărat afectate de politicile pe care le implementezi, dar despre care nu știi că sunt afectate, pentru că nu există canale de comunicare.

Problema este că nu putem să începem direct cu asta, din cauza responsabilității uriașe necesare, pe de o parte, și pe de altă parte din cauza lipsei de fonduri. Domeniul corporate are mult mai multe posibilități financiare decât ONG-urile. Și atunci când venim cu un produs în zona de politici publice, el trebuie să fie unul deja dezvoltat.

Pythia

M.S.: Asta ar putea atrage atenție și din alte zone adiacente, de exemplu cereri de la partide politice sau anumiți politicieni de a-l folosi, probabil în unele cazuri probabil în scopuri nu neapărat oneste sau etice. Cum v-ați raporta la astfel de situații?

L.M: Ne confruntăm cu întrebarea asta, crede-mă, de fiecare dată. Avem o politică foarte strictă: nu ne implicăm momentan în politică. Ca să putem să ne permitem să interacționăm cu domenii posibil politice, avem nevoie în primul rând de o declarație, o cartă a valorilor noastre etice pe care să o publicăm și care să fie ghidul nostru pentru a judeca dacă vrem să colaborăm cu un partener sau nu. Avem nevoie de un consiliu de etică.

Acestea sunt elemente pe care trebuie să le dezvoltăm la nivel organizațional înainte să ne permitem nouă înșine să colaborăm cu partide politice sau cu domeniul politic. Noi nu credem că o colaborare cu politicul este intrinsec rea. Politica este până la urmă o parte din viața noastră și și ea la rândul ei are nevoie de strategii de comunicare mult mai eficiente.

În schimb credem că cel mai rău lucru pe care îl poate face o companie este să nu-și asume valorile partenerilor cu care lucrează. Cambridge Analytica este un exemplu; din moment ce a colaborat cu campania lui Trump, ei nu pot să zică că sunt separați de acea campanie, sunt parte din ea și trebuiau să-și asume acest lucru. În momentul în care tu faci asta în secret, asta este imoral și neetic.

Singurul mod în care noi credem că poți să te implici în politică este complet asumat public și cu valorile tale pe față. Atâta timp cât noi ne asumăm aceste valori, atunci ar putea să fie ok, cu condiția să existe transparență totală. În momentul de față, nu suntem în această poziție. Nu vom intra în viitorul apropiat în domeniul politic, pentru că ne lipsesc componentele organizaționale.

Dar o să avem în curând o Cartă a valorilor care să fie publică, precum și un consiliu de etică care să aprobe anumite parteneriate care ar putea să fie mai sensibile. Valorile noastre de bază sunt transparența, asumarea acțiunilor pe care le facem, respectarea privacy-ului – și aici vreau sa scot în evidență o chestie interesantă.

Ce este frumos la Paradigm si la tipul acesta de studiu este ca nu ai nevoie de informații despre indivizi sau informații private, este un algoritm intrinsec privacy friendly. Adică sigur, el extrage aceste informații publice, dar are nevoie mai ales de tendințe globale, niște măsuri globale ale societății. Ca după aia noi să formăm modele abstractizate ale agenților într-o societate pe care să le analizăm.

De exemplu, noi, când analizăm comunitatea din sectorul 5 în București, să zicem, n-o facem cu oameni cu nume și prenume. Noi facem un model de simulare care să se potrivească și să prezică exact ce se întâmplă acolo, dar fără să avem nevoia să urmărim fiecare individ. Și asta este partea privacy friendly din algoritmul nostru, faptul că folosim măsurători globale ca să creăm un model social abstract care să ne permită să facem aceste analize.

Avem acest strat de separare pe care multe alte soluții de analiză socială nu îl au. Majoritatea oamenilor se concentrează pe a analiza rețeaua socială, a lua cât mai multe informații și a încălca cât mai mult privacy-ul.

M.S: Cum se integrează asta tocmai cu ideea de transparență despre care vorbeam mai devreme? Atunci când i se prezintă rezultatele unui client, vorbim de date anonimizate?

L.M: Când este vorba de persoane publice sau entități de business, ele nu sunt anonimizate, avem fix entitățile respective. Când vine vorba de comunități mai mari, de comunitățile din jurul unui influencer, de exemplu, acelea sunt anonimizate. Deci avem acest „two-tiered approach”, unde persoanele publice nu sunt anonimizate, dar comunitățile din jurul lor și practic modul în care interacționează, să zicem, baza de fani a unui influencer, acelea sunt anonimizate.

M.S: În ce stadiu sunteți cu proiectul în momentul de față?

L.M: Noi în momentul de față avem algoritmul testat în laborator și știm că funcționează. Sunt lucruri foarte interesante de dezvoltat la el în continuare. Tehnologia în sine este funcțională, o avem optimizată astfel încât să ruleze de câteva ordine de mărime mai rapid decât modelele care sunt aplicate în domeniul academic în momentul de față. Deci poate să fie aplicată pentru analize reale.

Dinamicile sunt testate în laborator, avem niște testări pe cazul susținerii independenței în Scoția. Însă ce trebuie să facem în continuare este să găsim niște parteneri strategici și niște viitori clienți cu care să lucrăm la dezvoltarea în continuare a algoritmului exact pe acest caz de utilizare, pe testarea lui pe teren.

La partea de AI și opinion mining, lucrăm acum la implementarea tehnologiilor. Suntem într-un stadiu foarte bun, în curând vom avea primul prototip funcțional , gata să fie testat pe teren.

M.S: Vă loviți de stigma sau, mai bine-zis, de frica de ideea aceasta de folosire a algoritmilor în analize sociale? Cum ați vedea o tentativă de schimbare a acestor opinii?

L.M: Într adevăr, există o stigmă care este puțin ipocrită față de aceste analize. E ipocrită puțin pentru că de fapt aceste analize se fac deja. Sigur, noi nu facem și nu vom face niciodată scoruri sociale pentru indivizi. Aici vorbim numai de entități de business pentru scorul de sustenabilitate.

Dar există stigma. Asta pentru că lumea se gândește la faptul că este o tehnologie nouă și că pot să fie spionați mult mai bine de ea. Ceea ce nu e adevărat, pentru că acele tipuri de algoritmi există deja și aș zice ca sunt mult mai înfricoșătoare decât ce facem noi. Algoritmii aceștia super avansați de profilare socială folosite de YouTube, de Facebook, sunt cu câteva ordine de magnitudine mai înspăimântători decât ce facem noi.

Noi încercăm să să facem exact opusul a ceea ce fac Facebook și marii giganți ai algoritmilor, care strâng și vând toate datele tale personale unor companii.

Planul nostru ca să atragem mai mult atenția față de faptul că există această metodă mult mai curată de a face analize sociale. Vrem să facem în paralel partea de development cu partea de cercetare, care vine automat; practic, vrem să contribuim prin dezvoltarea Paradigm și la nivel academic cu descoperirile pe care le facem. Planificăm să avem o strategie de comunicare pe viitor care să aducă la cunoștința publicului larg ce înseamnă de fapt tehnologia asta, ce înseamnă domeniul ăsta de studii, ce avansuri s-au făcut în ultima vreme. Vrem să contribuim la popularizarea domeniului și la deschiderea unor discuții mult mai aplicate pe ce înseamnă de fapt etica în epoca AI.

Iar profilarea se face tocmai pentru că companiile mari au nevoie să înțeleagă populația, dar nu au metodele să o facă, în afară de a profila individual oamenii, invadând intimitatea noastră zi de zi. În schimb, dacă ai avea metodele ca să înțelegi populația ca element în sine, comunitățile ca agenți în sine și să nu te mai uiți la indivizi așa de mult, dacă ai avea ecuațiile și modelele care guvernează mișcările comunităților sau mișcările de masă, nu ai mai avea nevoie la nivel strategic de această invazie a intimității.

Și. mai mult decât atât, odată ce ai modelele astea de înțelegere a mișcărilor sociale în masă poți să faci distincția foarte clară între ce înseamnă o necesitate onestă de a înțelege mișcările astea și o încercare de a invada intimitatea personală.

M.S: Un aspect care mi-a sărit în ochi din discuția asta: sunt o parte din scopurile pe care vi le propuneți influențate de ideea de psihoistorie din romanele lui Asimov?

L.M: Ne-ai prins. E mereu plăcut când vorbim cu cineva despre ce facem și ne zice „A, Hari Seldon”. Când zici aceste două cuvinte știm că suntem pe aceeași pagină.

Dar da, Asimov se baza pe o intuiție reală că poți să gândești societatea din punct de vedere termodinamic. Este așa de ușor pe cât a crezut Asimov? Clar că nu. Este posibil? Aparent este. Dacă iei instrumentele de statistică termodinamică, ele se aplică mai bine decât am fi sperat pe societate. Există cercetări care să demonstreze aceste paralele. Și dintr-o dată avem posibilitatea să extindem felul în care înțelegem mișcările sociale. Deci da, așa este. Paradigm este mare în parte inspirat de Fundația lui Asimov și domeniul psihoistoriei.