Cum a fost învins Facebook de va©©in

Toată lumea știe că Facebook este principalul canal de răspândire a știrilor false, în România și nu numai, și locul în care antivacciniștii se organizează și coordonează. Și, aparent, Facebook n-are niciun chef și niciun interes să fie altceva.

PR-istic vorbind, lucrurile sunt „roz”. Facebook se laudă într-un raport recent despre comportamentele neautentice de pe rețea că a închis 65 de conturi de Facebook și 243 de conturi de Instagram din Rusia, asociate cu Fazze, sucursala unei firme britanice de marketing, care răspândeau informații false despre vaccinuri în India, America Latină și SUA.

Știrea apăruse în contextul în care firma americană este acuzată chiar de Casa Albă că e principala cale de răspândire a dezinformărilor și falsurilor despre vaccinuri. Firma se apăra și spunea că închide conturi și că însoțește toate postările despre vaccinuri și COVID-19 cu avertismente și trimiteri la informații verificate.

De fapt, acele avertismente sunt, în esență, o metodă prin care Facebook se spală pe mâini de responsabilitate. Trecând peste faptul că suferă de un fenomen similar reclamelor, numit „banner blindness”, deci sunt ignorate de utilizatori din cauza expunerii repetate la ele, Facebook le trântește nediferențiat atât postărilor legitime, cât și celor antivacciniste.

Un avertisment pus de Facebook la o postare de pe pagina Mindcraft Stories.

Prin urmare, pentru un cititor neavizat, valoarea de (ne)adevăr a postărilor respective este egală, fix inversul a ceea ce ar fi trebuit să sugereze avertismentul.

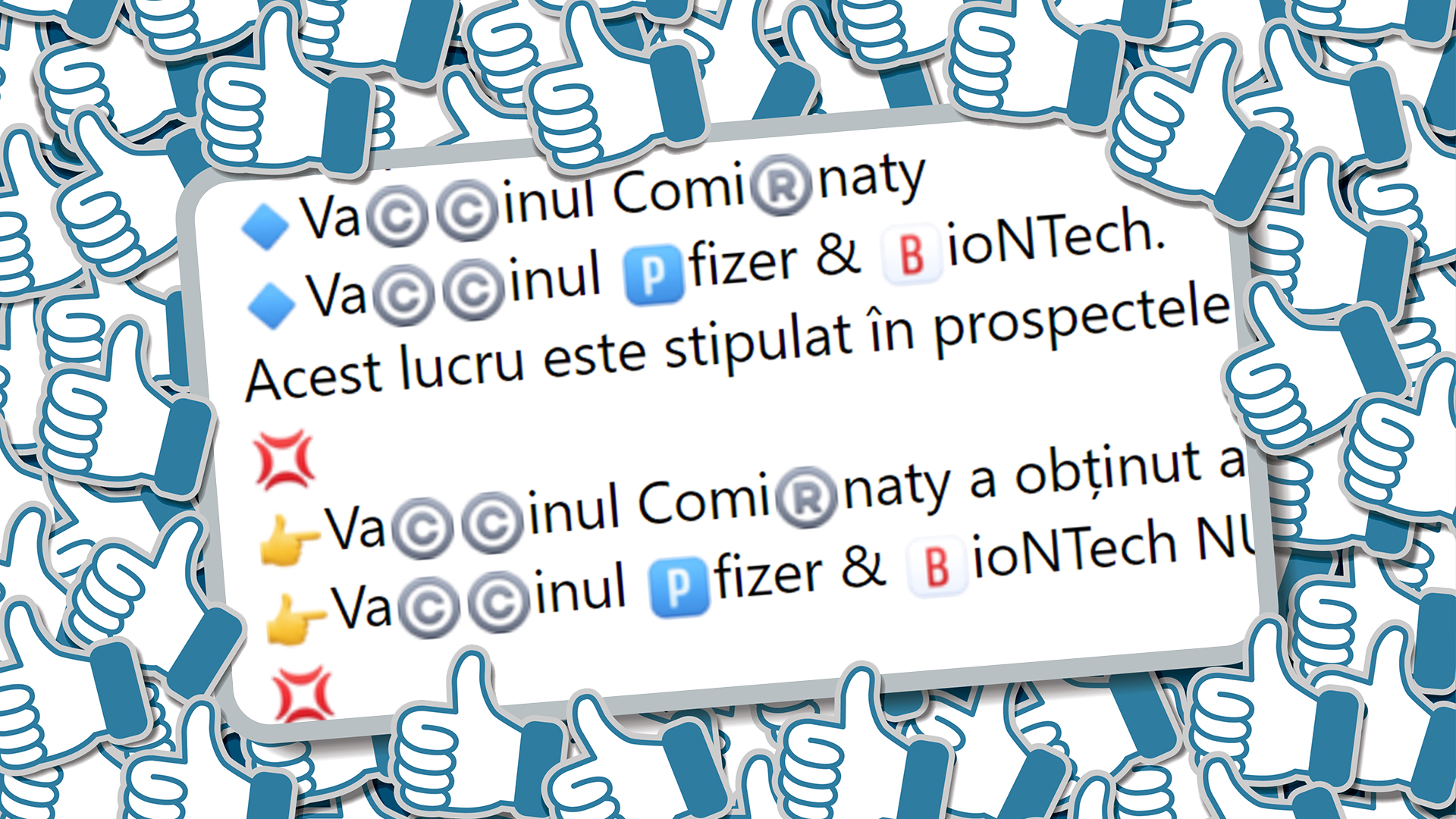

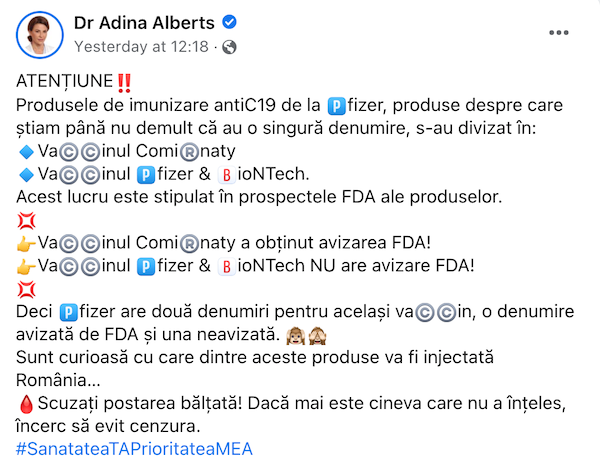

Ironia sorții este că antivacciniștii au descoperit, între timp, că avertismentul este aplicat automat, în funcție de cuvintele care apar în postare, prin urmare s-au apucat să ocolească algoritmul scriind, de exemplu „va©©in” în loc de „vaccin” (pagina Adinei Alberts e exemplul perfect). Algoritmul pare să nu se fi prins de această metodă barbară de a-l evita, așa că în momentul de față avertismentul apare doar la postările unor site-uri legitime, care chiar încearcă să publice informații verificate.

O postare în care literele sunt înlocuite cu diverse pictograme, pentru a ocoli algoritmul Facebook.

Facebook îngreunează eliminarea știrilor false și altfel. De exemplu, sistemul de raportare al informațiilor false despre sănătate nu dă niciun fel de feedback despre acțiunea luată. Dacă, de exemplu, cineva raportează o postare care conține hate speech, va primi o notificare despre decizia luată, indiferent care e. În cazul știrilor false, această notificare nu există. Senzația e că raportarea e ignorată, ceea ce, în esență, descurajează fix raportările.

Pare a fi o strategie deliberată a Facebook, care încearcă să facă totul pentru a se spăla pe mâini de această responsabilitate, prin diverse metode. De exemplu, profită de pandemie pentru a limita numărul de moderatori, sub pretextul că nu-i pot aduce la birou.

În esență, Facebook pornise acest sistem al moderării conținutului pentru că dorea să-și monetizeze platforma. Promisiunea lor era simplă și apetisantă pentru companiile care voiau să-și facă reclamă: o platformă „curată” (fără pornografie și torenți).

Tot Facebook a crezut, greșit, că, dacă obligă oamenii să-și pună un nume și o poză, aceștia nu se vor mai coborî la nivelul suburban de pe forumurile și paginile în care se folosesc nickname-uri. S-a dovedit că nu-i așa – plus că Mark avea nevoie de cifre bune pe care să le arate acelorași advertiseri, deci nu s-a stresat să închidă prea multe conturi false.

Lucrurile s-au complicat pe măsură ce tot mai mulți stakeholderi au început să ceară intervenția platformei (de la eliminarea extremismului până la, în esență, moderarea campaniilor electorale). Așa că Facebook alese deja să scape de problemă inventând un soi de Curte Supremă proprie, așa numita Oversight Board.

În esență, pare o decizie inteligentă – iată că un grup de oameni independenți decid ce e acceptabil pe platformă. În realitate, e doar o altă formă a oamenilor lui Mark de a se eschiva: „Nu-ți place decizia noastră, succes, vorbește cu băieții de la Oversight Board, poate te bagă cineva în seamă”.

Cum până acum au fost luate exact 15 decizii și cum, de exemplu, postările în română nici măcar nu sunt acceptate, e clar că scopul Facebook a fost de a crea un bottleneck, de a limita cât mai mult feedback-ul atât de mâncător de timp și de resurse (și de bani ce trebuie scăzuți din profit).

În condițiile în care algoritmul e păcălit cu ușurință, iar moderatorii nu fac față valului de mizerie la care sunt expuși zilnic, unii propun un sistem care implică utilizatorii și care acordă note pentru reputație, precum pe forumuri. Facebook are un astfel de sistem, însă e unul intern și secret, care determină ce și cum afișează rețeaua pe paginile altora. Pandemia a demonstrat clar că sistemul nu funcționează (Adina Alberts este, din nou, un exemplu).

O altă soluție ar fi crowdsourcing-ul, implicarea utilizatorilor în moderare. Într-un fel, Facebook o face prin sistemul de raportare (dar e clar că ar renunța la asta, din moment ce limitează feedback-ul) și oferind posibilitatea aceasta pe grupuri (care sunt, din păcate, o altă gaură neagră în care se răspândește masiv dezinformarea), dar ideea ar fi mai complexă: implicarea unor utilizatori cu reputație bună în moderarea întregului conținut (cam ca pe Wikipedia).

Nu știu dacă propunerile de mai sus ar fi niște soluții bune, ce este însă clar e că direcția în care a luat-o acum Facebook-ul, de a se spăla pe mâini de orice responsabilitate, e una greșită.